La paradoja del coste en la IA open source

Los modelos open source consumen de 1.5 a 4 veces más tokens en promedio

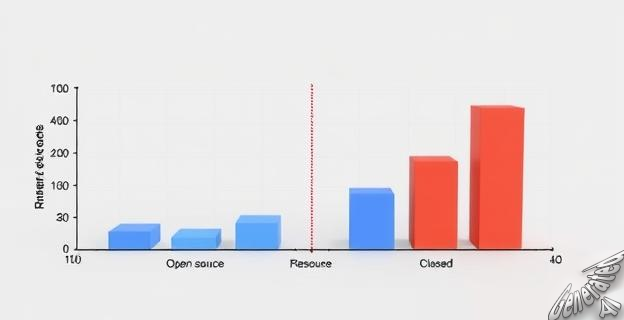

Un estudio de Nous Research encontró que los modelos de IA open source pueden consumir hasta 10 veces más recursos computacionales que los modelos cerrados para tareas simples. Aunque cada token cuesta menos en sistemas open source, si se usan muchos más para tareas sencillas, el coste total puede dispararse. Los modelos open source consumen de 1.5 a 4 veces más tokens en promedio, y en tareas simples, algunos modelos abiertos llegaron a usar hasta 12 veces más tokens que los modelos cerrados más eficientes. OpenAI se posiciona como líder en eficiencia, y Nvidia también mostró un uso optimizado de tokens. El estudio identificó importantes diferencias entre proveedores, y los modelos cerrados parecen estar optimizados deliberadamente para usar menos tokens. La eficiencia de tokens debe considerarse al mismo nivel que la precisión al desarrollar futuros modelos.