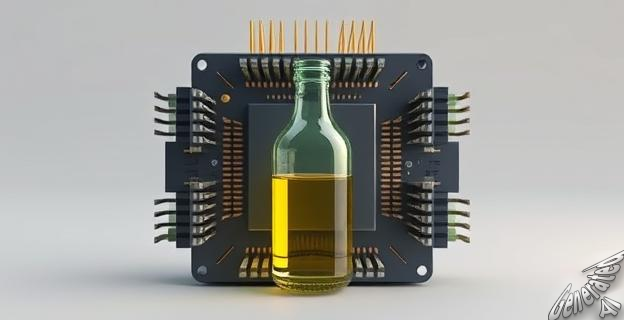

Un cuello de botella tecnológico está lastrando el desarrollo de la IA. La culpa la tiene el padre de la informática moderna

El cuello de botella de von Neumann limita la eficiencia de la IA debido al traslado de datos entre la memoria y el procesador

La inteligencia artificial se enfrenta a un problema técnico conocido como el 'cuello de botella de von Neumann', que limita su eficiencia y sostenibilidad. El entrenamiento de modelos de IA requiere cantidades colosales de datos y energía, pero la mayor parte del consumo no se debe al cálculo matemático en sí, sino al traslado de datos entre la memoria y el procesador. La separación entre memoria y procesamiento implica un freno, ya que la velocidad de transferencia de datos no ha crecido al mismo ritmo que la capacidad de cómputo. La industria tecnológica trabaja para mitigar esta limitación, explorando soluciones como la óptica integrada, la computación en memoria y la computación cercana a la memoria. IBM ha presentado módulos de guías de onda poliméricas que incorporan la velocidad de la fibra óptica directamente en los chips, reduciendo el tiempo y la energía necesarios para transferir datos. La computación en memoria permite realizar operaciones directamente dentro de la memoria, reduciendo drásticamente el tráfico de datos. El futuro probablemente combine lo mejor de ambos mundos, con sistemas híbridos que combinen la computación clásica con arquitecturas no-von Neumann para acelerar y hacer más sostenible el entrenamiento e inferencia de modelos de IA.