La IA de última generación sale más cara que nunca, aunque baje precios. El problema es que piensa más que antes

La unidad es barata, pero la cesta que consumimos es cada vez más voluminosa

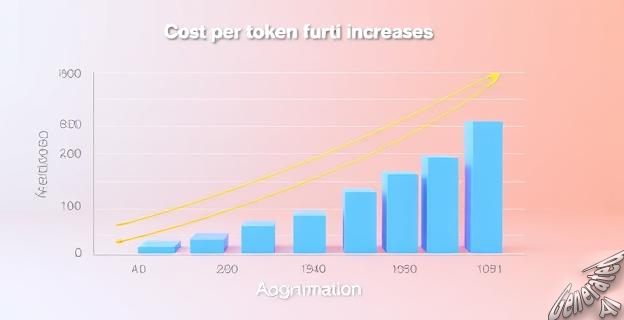

La inteligencia artificial de última generación resulta más cara que nunca, a pesar de que el costo por token disminuye. El problema radica en que los modelos piensan más que antes, lo que aumenta la cantidad de tokens necesarios para realizar tareas. La inferencia, que es el proceso de obtener respuestas de un modelo ya entrenado, se está abaratando, pero el costo extra introducido por las nuevas funciones de razonamiento dispara la cantidad de tokens utilizados. Los modelos requieren más tokens para realizar tareas como resumir documentos, generar código y analizar textos jurídicos. Las empresas que utilizan la IA están experimentando un aumento en sus costos, con Notion explicando que sus márgenes han disminuido debido a los costos de IA. Un estudio del MIT encontró que el 95% de las empresas que ofrecen aplicaciones de IA generativa no están obteniendo rentabilidad. Los costos de la IA varían según el modelo y la configuración, pero los volúmenes de tokens consumidos son significativos, con chat básico de preguntas y respuestas requiriendo ~50 a 500 tokens, resumen breve de un documento requiriendo ~200 a 6.000 tokens, y análisis jurídico de documentos requiriendo ~75.000 a 250.000+ tokens.