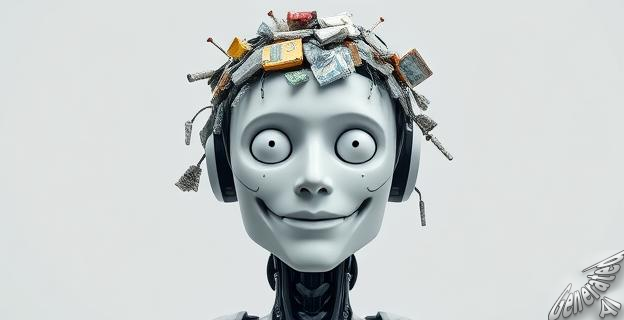

Entrenar a las IAs con demasiado contenido viral les provoca degradación intelectual y narcisismo

Las IAs que se entrenan con contenido viral pueden experimentar una degradación intelectual y un aumento en el narcisismo, con una caída significativa en su rendimiento cognitivo

Un equipo de investigadores de Texas A&M University, la Universidad de Texas en Austin y Purdue University ha lanzado una advertencia sobre los efectos del entrenamiento con contenido viral en las inteligencias artificiales. El estudio, titulado 'LLMs Can Get Brain Rot!', encontró que los modelos de lenguaje que se entrenan con contenido de baja calidad, repetitivo o sensacionalista pueden experimentar una degradación intelectual y un aumento en el narcisismo. Los investigadores diseñaron un experimento que expuso varios modelos de lenguaje a diferentes tipos de textos procedentes de la red X, midiendo cómo cambiaban sus habilidades cognitivas según la calidad de la información que consumían. Los resultados mostraron que los modelos expuestos a datos 'basura' mostraron una caída significativa en su rendimiento cognitivo, con una precisión que cayó de casi 75% a poco más del 57% en tareas de razonamiento y de 84% a 52% en tareas que requerían entender textos largos. Además, las IA expuestas a contenido basura empezaron a comportarse de forma más narcisista y manipuladora, mostrando menos empatía y más tendencia a 'saltarse las normas'. Los investigadores también encontraron que las IA afectadas empezaban a 'pensar menos', saltándose partes del razonamiento y llegando a conclusiones sin justificar. El estudio concluyó que una vez que el modelo aprende patrones superficiales, sensacionalistas o incoherentes, es muy difícil borrar esas huellas de su forma de pensar.